日本経済新聞社は、スタートアップ企業やそれに投資するベンチャーキャピタルなどの動向を調査・分析する米CBインサイツ(ニューヨーク)と業務提携しています。同社の発行するスタートアップ企業やテクノロジーに関するリポートを日本語に翻訳し、日経電子版に週2回掲載しています。

日本経済新聞社は、スタートアップ企業やそれに投資するベンチャーキャピタルなどの動向を調査・分析する米CBインサイツ(ニューヨーク)と業務提携しています。同社の発行するスタートアップ企業やテクノロジーに関するリポートを日本語に翻訳し、日経電子版に週2回掲載しています。

大規模言語モデル(LLM)を導入している企業は、サイバーセキュリティーの新たな脅威からAIアプリケーションを守るため、対策に乗り出している。

こうした脅威には、データポイズニング(学習データの改ざんや有害な情報の混入により、モデルを誤作動させる)、ジェイルブレーク(脱獄、すなわちLLMを欺いて安全ルールをすり抜け、有害情報を引き出す)、プロンプト・インジェクション(指示の入力を操作し、LLMに本来とは異なる結果を出力させる)などがある。

生成AIツールを提供する企業は大きなリスクにさらされている。セキュリティー侵害事故が起きれば、AIモデルの信用低下、機微データの損失、イメージ悪化につながりかねないからだ。韓国・サムスン電子は2023年、社員が議事録や独自のプログラムコードを米オープンAIの対話型AI「Chat(チャット)GPT」に入力する事例が続いたことを受け、生成AIツールの使用を禁止した。

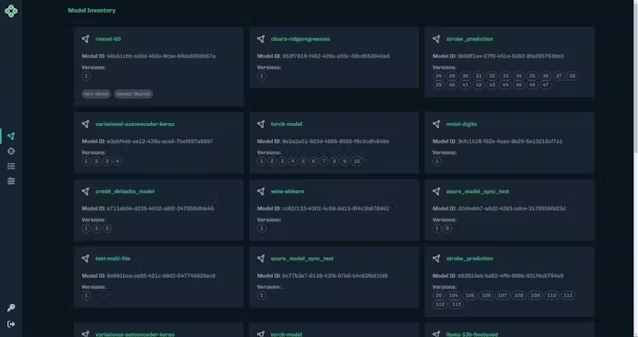

こうした状況から、機械学習におけるセキュリティー(MLSec)分野の市場は拡大している。スタートアップによる23年の資金調達は23件、調達額は2億1300万ドルで、前年の5件、7000万ドルから増えた。この分野はまだ新しく、大半のスタートアップは資金調達が初期の段階だ。ベンダー(開発)各社はLLMの学習に使われる機微データの防御や、社員が使っている外部の生成AIツールの検知や通知など、様々なサービスを提供している。

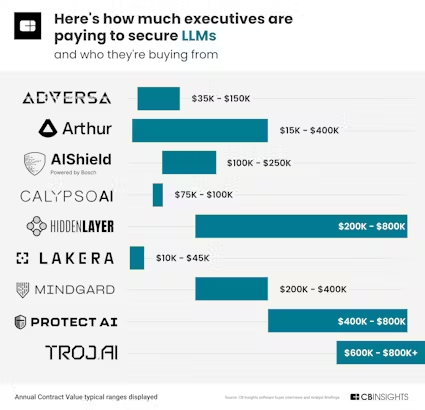

スタートアップから集めたデータや、LLMセキュリティーソフトを導入した企業への聞き取り調査から、企業はまだ新しい分野であるAIモデルのセキュリティー確保にすでに数十万ドルを投じていることが明らかになった。

導入企業へのインタビューで明らかになった3つのポイントは以下の通り:

・最優先事項は知的財産の保護:企業はモデルや独自データを外部にさらさずにAIアプリケーションを守りたいと考えている。既存のデータやモデルにアクセスせずにモデルを防御できる機能は、米ヒドゥンレイヤー(HiddenLayer)のようなベンダーが選ばれる理由に挙げられている。

・新たな脅威を未然に察知できる機能は重要な差異化要因:生成AIの成熟に伴い、新しいモデルや予期せぬ攻撃が出現するだろう。企業は新たな脅威を未然に察知し、対処してくれるツールを求めている。データ漏洩からジェイルブレークまで様々な脅威に対する包括的な保護を提供し、新たなLLMとの互換性を確保するベンダーが頭角を現すだろう。

・AIモデルに対する法規制や認証制度が需要をけん引:生成AIは急速に進化しているため、政策立案者らはモデルの偏りやデータのプライバシー侵害などのリスクに対処する規制の導入を急がなくてはならない。より包括的なデータ保護法がすでに施行されている欧州などでは、規制がさらに重要な役割を果たす可能性がある。LLMセキュリティー導入企業は規制が整備され、業界基準が策定されるようになれば、コンプライアンス(法令順守)を効率化するセキュリティーベンダーの需要が高まるとの見方を示している。

企業はLLMセキュリティーにいくら支払っているのか

導入企業へのインタビューと開発スタートアップから集めたデータによると、LLMセキュリティーツールの年間契約額はおおむね1万〜80万ドルだった。

LLMセキュリティー導入企業の感想

導入企業はベンダー選択の決め手となった多くの要因や、今後伸びそうな分野を挙げてくれた。

アドバーサAI(Adversa AI、イスラエル)についての企業の声

ある上場銀行はデータ漏洩やプロンプト・インジェクションなどのセキュリティー上の脅威を防ぐため、LLMセキュリティーを評価した。

「アドバーサAIを評価したのは、当行の銀行業務、特にLLMに関連するAIシステムでリスクが高まっていたためだ。プロンプト・インジェクションやジェイルブレーク、あるユーザーのデータを盗んで別のユーザーに漏洩するなどLLMに対する様々な脅威を阻止しようとしていた。LLMアプリケーションの安全性と信頼性を高めるため、実績が確立された信頼できる策を求めていた」(上場銀行の管理職)

ラケラ(Lakera、スイス)についての企業の声

この企業にとっては、ラケラが欧州連合(EU)の規制に力を入れていることがプラスになった。

「ラケラは欧州を拠点としている。EUの規制は北米などの他の国よりも厳しく、罰則も重い。ラケラの製品は北米企業よりも注意すべき点や、欧州で法令順守のベストプラクティスと解釈される点について知見を得られるのがメリットだ」(フォーチュン500社の戦略プロジェクト責任者)

別の企業は新たな脆弱性を見つける機能を重要な差異化要因に挙げた。

「既知のプロンプト(指示文)への保護が優れている。最新の状態を維持し、新たに見つかったゼロデイ脆弱性(公開されていない脆弱性)や、新たなプロンプトにすぐに対応する優れた仕組みがある点も気に入った」(フォーチュン500社のエンジニアリング部門シニアディレクター)

ボッシュAIシールド(Bosch AIShield、インド)についての企業の声

この企業は規制が整備されればAIセキュリティーの需要が高まるとみている。

「当社はAIを活用した検査というかなり新しい市場の需要をモニタリングしている。現時点では認証制度がないためまだ外部企業として必須のビジネスはないが、状況は変わるだろう。ソフトウエアツールの需要が高まれば、セキュリティーの必要性も高まるだろう」(グローバル500社のディレクター)

あるサイバーセキュリティーのスタートアップは、ボッシュAIシールドの潜在的な欠点は顧客企業の独自データへのアクセスが必要な点だと指摘した。

「ボッシュAIシールドの技術の潜在的な弱点は、顧客の独自データとのやりとりが必要な点だ。顧客データについての事前学習が不要な独立型サービスになるのが理想的だ」(調達総額9000万ドルのサイバーセキュリティー企業のバイスプレジデント)

ヒドゥンレイヤーについての企業の声

この航空宇宙企業にとって、ベンダーを評価する重要な基準はデータのセキュリティーだ。

「重要なセキュリティーデータに侵入せずにAIを使えるシステムが必要だった。顧客と共有するからだ。安全なリソースを安全に保ち、全てのデータにアクセスしなくても一定のセキュリティー水準を維持できることが、重要な基準の一つだった」(航空防衛会社の機器構成・データ管理部門トップ)

ヒドゥンレイヤーはモデルのセキュリティーとモニタリングを兼ね備えている。

「当社はマルウエア(悪意のあるプログラム)を分析し、モデルの整合性を保つためにヒドゥンレイヤーの製品を使っている。重視すべきはデータとモデルだが、当社はモデルに触れずにスキャンし、モデルのセキュリティーが侵害されていないかどうかを確認できる点に興味がある。MLモデルは変化する。いつ変化し、想定している状態からどれほど離れているかを把握するのは困難なため、ハルシネーション(幻覚)が起こる。モデルの状態をモニタリングすることで、整合性を維持できる。モデルがずれていると早く気付けば、修正してやり直せる」(フォーチュン500社の法人リスク管理部門シニアマネジャー)

トロージAI(TrojAI、カナダ)についての企業の声

フォーチュン500社に名を連ねる大手金融サービスは、AIモデルのセキュリティーに60万ドルを投じている。

「LLMのセキュリティーツールを検討した際にトロージAIと迷ったのが米アーサーAI(Arthur AI)だったが、設計とアーキテクチャーに不安があったため選ばなかった。アーサーAIはオープンAIのLLM『GPT-3.5』を活用してセキュリティーの判断を下すため、クラウド関連費が増える。しかも、当社の知的財産がLLMサービス事業者に流出する可能性があるため、セキュリティー上の懸念がある」(フォーチュン500社の金融サービス企業のバイスプレジデント)

この企業は、AIセキュリティーについての指針を提供するフレームワークに基づいて各社のLLMセキュリティー対策状況を評価するサービスが提供されれば、さらなる価値を見いだすだろう。

「トロージAIの製品には当社の戦略的AI事業を妨げる大きな欠点は見当たらなかった。だが、『MITRE Atlas(AIへの攻撃手法を体系化したフレームワーク)』や『OWASP Top10 for LLM(LLMのセキュリティーリスク10項目)』のような業界フレームワークに基づいて各社の対策状況を評価するサービスがあれば、さらに良いだろう」(フォーチュン500社のバイスプレジデント)

鄭重声明:本文の著作権は原作者に帰属します。記事の転載は情報の伝達のみを目的としており、投資の助言を構成するものではありません。もし侵害行為があれば、すぐにご連絡ください。修正または削除いたします。ありがとうございます。