日本経済新聞社は、スタートアップ企業やそれに投資するベンチャーキャピタルなどの動向を調査・分析する米CBインサイツ(ニューヨーク)と業務提携しています。同社の発行するスタートアップ企業やテクノロジーに関するリポートを日本語に翻訳し、日経電子版に週2回掲載しています。

日本経済新聞社は、スタートアップ企業やそれに投資するベンチャーキャピタルなどの動向を調査・分析する米CBインサイツ(ニューヨーク)と業務提携しています。同社の発行するスタートアップ企業やテクノロジーに関するリポートを日本語に翻訳し、日経電子版に週2回掲載しています。

LLMを導入している企業の費用は数百万ドル(数億〜十数億円)に上る場合もある。企業はAIの費用対効果を重視しており、LLMよりもパラメーター数が少なく、学習コストを抑えられ、運用しやすいSLMが魅力的な選択肢になりつつある。巨大テックからスタートアップまで、SLMを手掛ける企業はこの1年で増えている。

小規模モデル(軽量モデル)は分野を絞ったデータセットで学習させることにより、大規模モデルに勝るとも劣らない精度と性能を持たせ、対象アプリケーションに磨きをかけることができる。

今回のリポートでは、SLM導入企業へのインタビュー、提携、独自スコアなどCBインサイツのデータを活用し、企業のSLMの導入状況やこの分野で増えつつあるライバルについて調べた。

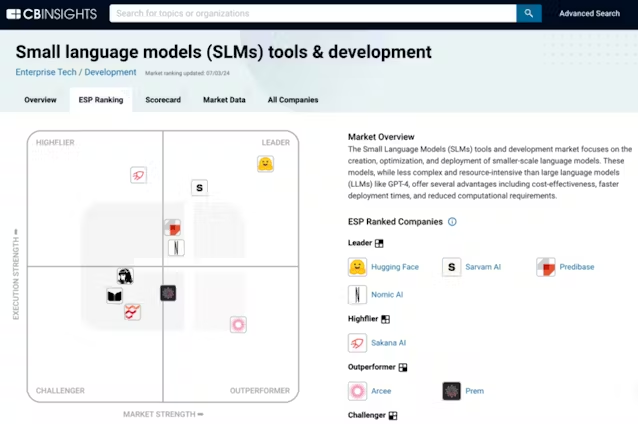

ポイント・この1年で10社以上のSLM開発プラットフォームが登場している。半数以上が製品を既に商業展開し、新たな資金を調達している。

・SLMは医療や金融などデリケートなデータを扱う分野に適している。特定のタスクをこなせるよう確実に微調整できるからだ。

・巨大テックはSLMを自社開発し、この分野のスタートアップを脅かしている。特に注目すべきはグーグル、米メタ、米マイクロソフトだ。

この1年で10社以上のプラットフォーム登場

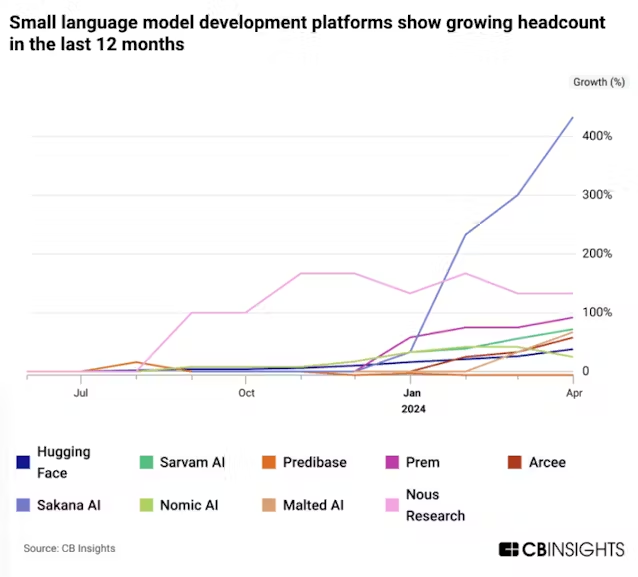

CBインサイツのデータによると、SLMツールと開発市場のスタートアップ11社のほぼ全てがこの1年で創業し、そのうちの約半数が既に製品を商業展開している。

人員を増やしているスタートアップも過半数に上っており、SLMの導入拡大に伴うこの分野の勢いを示している。

例えば、米ハギングフェイス(Hugging Face)のようなオープンソースの開発プラットフォームは、SLM向けのインターフェースやライブラリーを提供している。LLMよりも少ない資源で特定のタスク向けに微調整できる様々な学習済みモデルを提供しており、企業は自社に応じたSLMを簡単に利用できる。

ある医療保険会社の機械学習担当バイスプレジデントは、医療モデルの学習ソリューションが必要になり、ハギングフェイスのオープンソースのライブラリーに注目した。2024年5月のインタビューで、自社で活用する場合のSLMの有用性を強調した。

「SLMは今後主流になるだろう。医療分野の事務負担の一部など、大半の用途では巨大なLLMを自前で持つ必要はない」(多くの国で事業を展開する上場医療保険会社の機械学習担当バイスプレジデント)

一方、米プレディベース(Predibase)や米グレイブ(Glaive)などのスタートアップ(いずれもCBインサイツの24年の有望AI100社に選ばれた)も、小規模なタスク特化型モデルの開発を支援している。グレイブは23年9月、14万以上の合成プログラミングの問題と解決策で学習したコード生成小規模モデル「Glaive-Coder-7b」を公開した。

プレディベースはパラメーター数が20億〜70億のタスク特化型モデルの開発、学習、微調整、導入・運用を支援している。同社の調達総額は2850万ドル(約43億円)で、情報抽出、トピック分類、固有表現抽出などのタスクを可能にする。

サカナAI(Sakana AI)のように、日本語など特定の言語に対応したSLMを開発しているスタートアップもある。同社はNTTと提携して複数のSLMを開発している。

SLMが普及すれば、LLM開発各社は小規模モデルも手掛けるようになるだろう。例えば、フランスのミストラルAI(Mistral AI)は23年9月、独自のSLMを公開した。巨大テックもこの分野で活発に動いている(詳細は後述)。

デリケートなデータを扱う業界に適合

SLMは金融、医療、法律など特にデリケートなデータを扱う業界で普及しそうだ。

SLMはLLMよりも構造がコンパクトなため、ローカルで展開しやすく、データを外部サーバーではなく顧客の環境内にとどめることができる。このため、デリケートなデータを扱う業界の機密性やプライバシーの懸念に対処しやすい。

例えば、23年12月に取材したある小児病院の最高情報責任者(CIO)は、データサイエンス基盤の米データロボット(DataRobot)を活用して様々な種類のモデルを構築し、評価しようとしていた。このCIOはオンプレミス(自社所有)でプラットフォームを運用する重要性について説明した。

「製品を選ぶ際の重要な基準は、オンプレミスで運用できるかどうかだ。データを病院の外に出さずにオンプレミスで実行できる点だ」(小児病院のCIO)

特定の業界を対象にしたSLM開発プラットフォームもある。例えば、米アーシ―(Arcee)は法律、医療、金融などの業界向けのSLM開発プラットフォームだ。顧客の過去の仕事に基づいて法的要約のドラフトを作成するモデルや、患者データに基づいて患者と医師らをマッチングするモデルなどがある。

医療の分野でも、米ライター(Writer)のパラメーター数200億の「PalmyraMed」や、中国のアント・グループが手掛ける同100億の「AntGLM-Med」が生物医学の質問に答えている。

巨大テック、スタートアップの脅威に

巨大テックもSLMを手掛けており、膨大な資源と確立された顧客基盤により新興勢を脅かす可能性がある。

マイクロソフトは24年4月、オープンSLM群「Phi(ファイ)-3」を発表し、パラメーター数38億のSLM「Phi-3 mini」をクラウドサービス「Azure(アジュール)」とハギングフェイスで利用できるようにした。

マイクロソフトのサティア・ナデラ最高経営責任者(CEO)は24年4〜6月期決算の説明会で「当社はLLMに匹敵する性能を備えつつも、ノートパソコンやモバイル端末で運用できる世界で最も人気のSLMも開発している。例えば、アンカー、アシュレイ、AT&T、アーンスト・アンド・ヤング(EY)、トムソン・ロイターはいずれもファイの活用法を探っている」と話した。

米アップルも4月、チャットボットやAIアシスタント向けに微調整されたモデルなど、端末で動作するSLM群「OpenELM(オープンソースの効率的な言語モデル)」を発表した。

一方、メタは新たなオープンソースLLM「Llama(ラマ)3」を発表した。80億パラメーター版の性能はグーグルのSLM「Gemma(ジェマ)」やミストラルの「Mistral 7B」など同規模のライバルをしのぐとされる。

グーグルはこのほど、オープンソースSLM「Gemma2」を発表した。7月に公開予定の270億パラメーターの軽量モデルを含んでいる。グーグルラボのバイスプレジデントによると、このモデルの性能はパラメーター数が2倍のモデルよりも優れており、米エヌビディアのGPU(画像処理半導体)や、グーグル・クラウドのAI開発基盤「Vertex (バーテックス)AI」で1TPU(テンソル・プロセシング・ユニット、グーグル独自のAI半導体)ホストで動作するよう最適化されている。

このSLMは24年2月に発表された初代Gemma(パラメーター数が20億と70億の2つのオープンソースモデルからなる)の新バージョンだ。大手テック企業は小規模モデルの開発により、AIの性能強化に取り組んでいる。このトレンドはノートパソコンやモバイル機器に生成AIアプリケーションを導入する取り組みを進めていることも示している。

鄭重声明:本文の著作権は原作者に帰属します。記事の転載は情報の伝達のみを目的としており、投資の助言を構成するものではありません。もし侵害行為があれば、すぐにご連絡ください。修正または削除いたします。ありがとうございます。